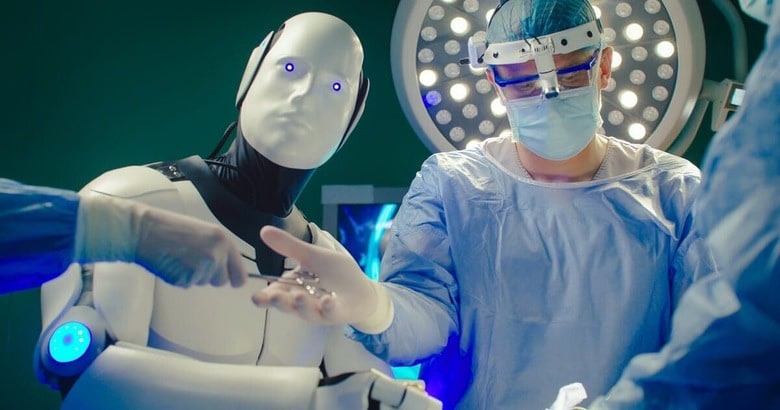

<AIは既に医師免許試験で高得点をマークするなど人間の医師に取って代わる日が近いと言われているが、人間の医師に比べて「圧倒的に欠落している能力」がある>

AI(人工知能)は、臨床医よりも正確な判断ができるようになった。AIが人間の医師に取って代わる日も遠くない──。そんなことが最近言われるようになった。

2022年11月に大規模言語モデル(LLM)を活用した対話型AI「チャットGPT(ChatGPT)」が発表されると、MCAT(医学大学院進学適性試験)や米医師免許試験(USMLE)の合格ラインを超えたとか、分野によっては専門医よりも正確な診断を下し、患者の満足度も高いといった研究結果が相次いで発表された。

それならAIの認知能力を人間向けのテストで調べてみようじゃないかと、イスラエルのハダッサ医療センターの神経学者ロイ・ダヤンら3人の研究チームは(面白半分で)考えた。

それもアメリカ大統領のメンタル面の適性を調べるときにも使われる検査を用いるのだ。すると、世界を席巻するこのテクノロジーに「現実的な欠陥」があることが分かったと、ダヤンは言う。

研究に参加したのはダヤンのほか、やはりハダッサ医療センターの認知機能の専門家であるベンヤミン・ウリエルと、テルアビブ大学のデータ科学者ガル・コプレウィッツだ。

3人は、5つのメジャーな生成AI(GPT-4、GPT-4o、クロード、ジェミニ1、ジェミニ1.5)に、世界的に使われているモントリオール認知評価検査(MoCA)をやらせてみた。

次のページ